Você provavelmente já ouviu falar sobre ChatGPT, um novo hype quando o assunto é inteligência artificial. Mas sabe de fato quais são os riscos ao usar esse chat generativo?

Sobre o Chat GPT

O ChatGPT é um large language model (LLM) de inteligência artificial ( IA) desenvolvido pela OpenAI que utiliza uma grande quantidade de dados para gerar respostas coerentes e contextualizadas, permitindo interações mais humanizadas com os usuários. Com a capacidade de processar, solucionar, organizar ou facilitar atividades do dia a dia, essa forma de inteligência artificial pode ser usada em diversas aplicações, como assistentes virtuais, chatbots, sistemas de tradução automática e até mesmo para revisão de código de aplicações.

Uma das principais vantagens de IA como o ChatGPT é a capacidade de simplificar e agilizar tarefas que antes exigiam um grande esforço manual ou humano. Além disso, o modelo pode ser utilizado como organizador e solucionador de problemas, fornecendo respostas precisas e rápidas para questões complexas. Esses benefícios fazem do ChatGPT uma ferramenta valiosa para empresas e organizações que buscam melhorar sua eficiência e produtividade, além de proporcionar uma melhor experiência ao usuário.

Os LLM têm despertado um grande interesse na comunidade científica e empresarial por seu potencial em transformar a maneira como as pessoas interagem e se comunicam com a tecnologia. Porém, esse potencial pode trazer riscos dependendo de como se é usado, tanto em empresas quanto na vida das pessoas no geral, quando por exemplo se compartilha senhas ou dados pessoais.

Riscos ao usar em Empresas

É importante que as organizações identifiquem e avaliem os riscos que podem surgir com o uso do ChatGPT. Devemos entender que o ChatGPT é uma ferramenta em desenvolvimento e eventualmente pode fornecer respostas inconsistentes, informações desatualizadas e até mesmo erradas. Conforme dito no artigo de Mitoma, da universidade de Chiba, “outra preocupação dos modelos de linguagem é a falta de consciência do contexto que é necessário para entender o significado de uma solicitação ou pergunta específica. Isso pode resultar em respostas inadequadas ou ofensivas e que podem causar danos ou confusão”.

Ademais, também como um motivo de ser um período de teste da IA, e juntando o fato de ser uma plataforma pública, não é recomendado que se insira dados pessoais na ferramenta. Um exemplo desse risco, foi o incidente de vazamento de dados do ChatGPT no dia 20 de março de 2022, que de acordo com o site canalTech, a OpenAI desligou seus servidores por conta de vulnerabilidades, e após um tempo, confirmou vazamento de dados sensíveis, incluindo histórico de conversa dos usuários.

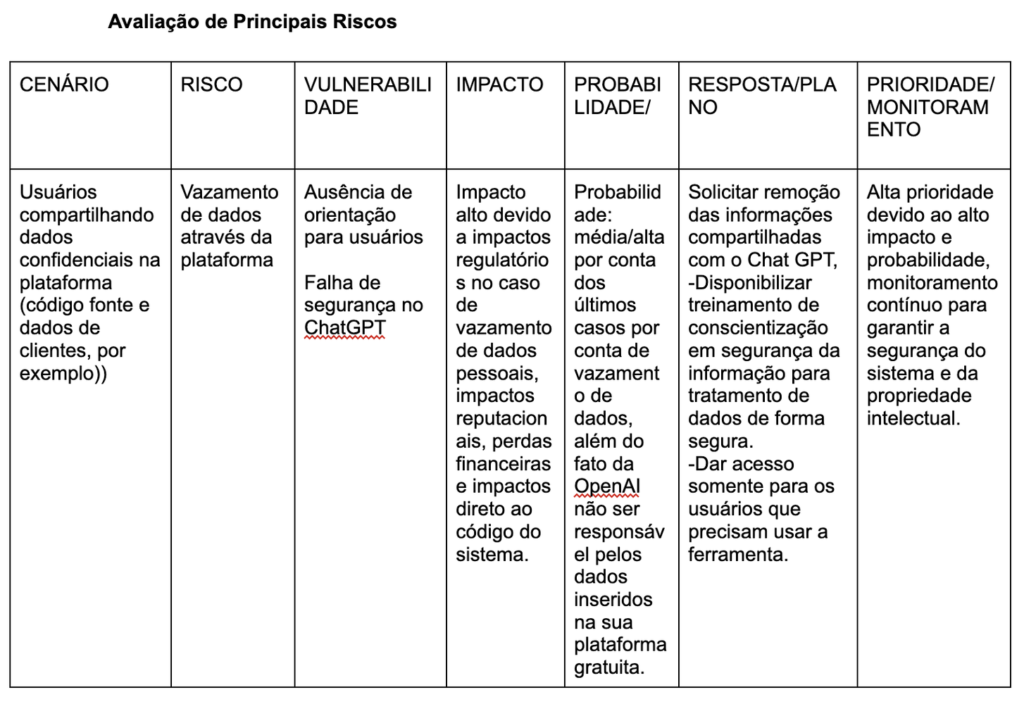

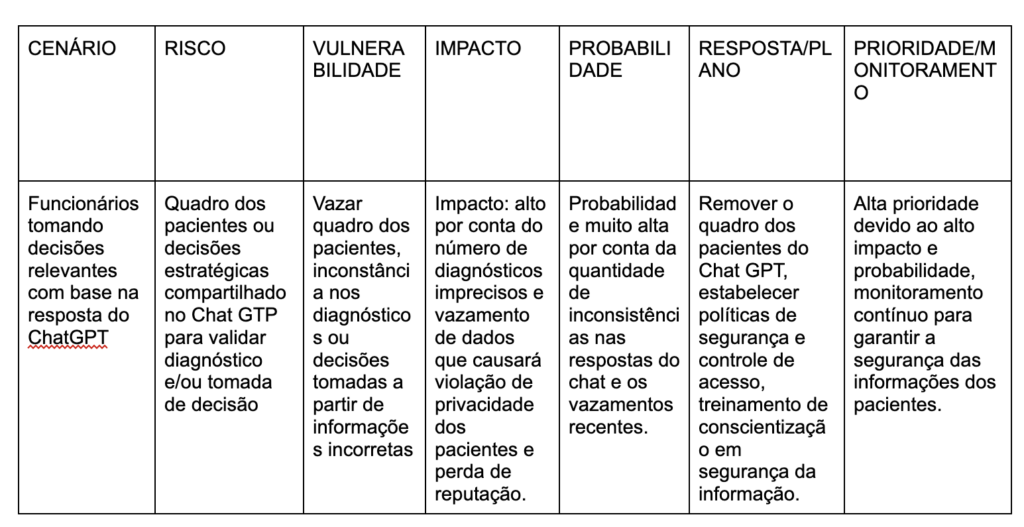

Dado esse cenário, os alunos da Edutalent fizeram uma avaliação de riscos cibernéticos considerando uma empresa hipotética de saúde que compartilhava informações sensíveis com o ChatGPT, onde foram considerados riscos relacionados a vazamentos de dados e inconsistências nas respostas, podendo causar até mesmo uma violação regulatória (Lei Geral de Proteção de Dados, por exemplo), impactos reputacionais, diminuição de clientes e perdas financeiras. Com isso, montamos algumas tabelas de riscos:

Vale a pena ressaltar, que na versão gratuita do ChatGPT, a OpenAI não se responsabiliza pela segurança dos dados que são compartilhados, já na versão paga, é possível negociar termos e cláusulas para a proteção dos dados, sendo assim, se houver um problema futuro, o cliente pode descarregar certas responsabilidades para a desenvolvedora. Isso é algo muito importante para as empresas, já que é um ótimo método de diminuir os riscos citados acima, ainda assim, se faz necessário que as empresas consumidoras desse serviço avaliem os benefícios e riscos de usufruí-lo e tenham consciência da forma e de quando está sendo utilizado.

Portanto, vimos que o ChatGPT pode oferecer benefícios e oportunidades para as empresas como a redução do tempo de resposta e automação de tarefas. Junto deles, há também novos riscos aos quais as empresas podem estar expostas ao usar a ferramenta de forma inadequada. Por isso, é necessário rever os critérios de utilização da IA, a fim de evitar possíveis vazamentos ou problemas futuros.

Estudo feito pelos alunos da Edutalent: Kaian Muniz, Luis Henrique Cardoso, Moreno Benedicto

________________________________________________________________

Referências:

Mitoma, Shun. “As preocupações dos grandes modelos de linguagem.” Applied Stochastic Models in Business and Industry 33.1 (2023): 3-12.

_______________________________________________________________